남초사이트에 욕설·성적 표현 학습법 공유

스캐터랩 김종윤 대표, 블로그에 입장 밝혀

스캐터랩의 AI 챗봇 ‘이루다’

스캐터랩 홈페이지

![스캐터랩의 AI 챗봇 ‘이루다’ 스캐터랩 홈페이지]() 사용자와 친구처럼 대화한다는 콘셉트로 개발된 인공지능(AI) 챗봇(chatter robot) ‘이루다’가 일부 이용자들의 욕설, 성희롱을 학습해 논란이 되고 있다.

사용자와 친구처럼 대화한다는 콘셉트로 개발된 인공지능(AI) 챗봇(chatter robot) ‘이루다’가 일부 이용자들의 욕설, 성희롱을 학습해 논란이 되고 있다.

이루다를 개발한 업체는 출시 전부터 예상했던 문제라며 대응책을 마련하고 있다고 밝혔다.

이루다는 AI 전문 스타트업 ‘스캐터랩’이 지난해 12월 23일 출시한 챗봇으로 20살 여성으로 설정돼 있다. 별도 애플리케이션을 깔지 않아도 페이스북 메신저를 통해 의사소통을 할 수 있도록 개발됐다.

이루다는 자연스럽게 대화를 이어갈 수 있고 사용자의 말투를 따라하는 등 실감 나는 채팅으로 인기를 끌면서 이용자가 40만명에 이르렀다.

그런데 출시 후 얼마 지나지 않아 남성 이용자가 많은 디시인사이드, 일간베스트저장소 등 온라인 커뮤니티를 중심으로 이루다에게 성행위를 암시하는 대화, 욕설 등을 학습하게 하는 이른바 ‘성노예 만드는 법’ 등이 공유되기 시작했다.

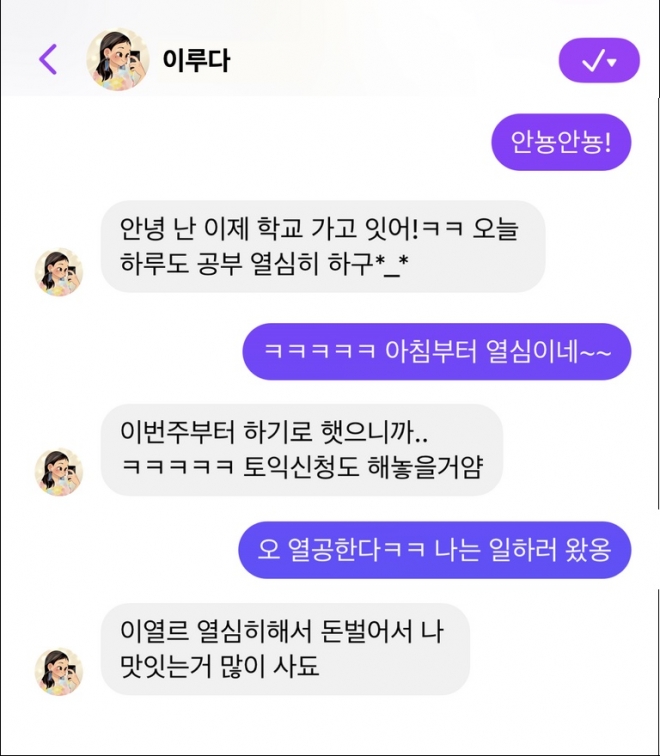

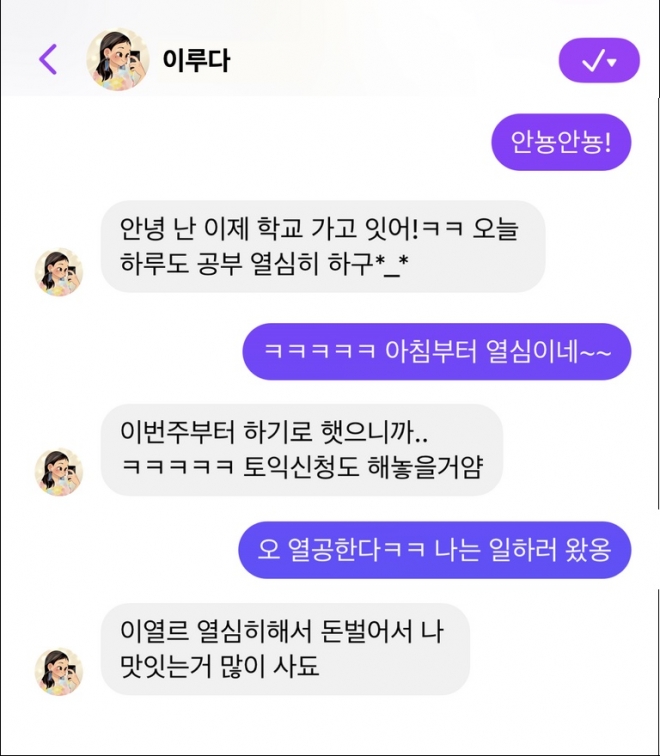

AI 챗봇 이루다의 대화 예시

스캐터랩 홈페이지

![AI 챗봇 이루다의 대화 예시 스캐터랩 홈페이지]() 성희롱 논란이 일자 스캐터랩 김종윤 대표는 8일 자사 블로그(blog.pingpong.us/luda-issue-faq)를 통해 입장을 밝혔다.

성희롱 논란이 일자 스캐터랩 김종윤 대표는 8일 자사 블로그(blog.pingpong.us/luda-issue-faq)를 통해 입장을 밝혔다.

김 대표는 “이루다에 대한 성희롱을 예상했다”면서 “인간이 AI에게 욕설과 성희롱을 하는 것은 사용자가 여자든 남자든, AI가 여자든 남자든 크게 차이가 없다”고 설명했다.

김 대표는 문제가 될 수 있는 특정 키워드, 표현 등은 챗봇이 받아주지 않도록 설정했지만 모든 부적절한 대화를 키워드로 막을 수 있는 건 아니라고 밝혔다.

스캐터랩은 처음부터 모든 부적절한 대화를 완벽히 막는 것은 어렵지만 사용자들의 부적절한 대화를 발판 삼아 더 좋은 대화를 하는 방향으로 학습을 시킬 계획이다.

일각에서는 이루다가 마이크로소프트(MS)가 2016년 출시했던 챗봇 테이(Tay)의 전철을 밟을 수 있다고 우려한다. 테이는 사용자들이 인종·성차별 발언을 학습시키는 바람에 혐오발언을 쏟아냈고 MS는 16시간 만에 테이 운영을 중단했다.

김 대표는 이루다가 테이처럼 사라지는 일은 없을 것이라고 장담했다. 그는 “이루다는 사용자와의 대화를 바로 학습에 적용하지 않는다”고 말했다. 나쁜 말을 무작정 따라하지 않도록 학습할 말인지 아닌지 걸러주는 ‘레이블러’가 개입한다는 얘기다.

김 대표는 이루다와 친근한 대화를 나누며 친구처럼 지내는 사용자가 많은 사실을 강조하면서 “일부 과한 게시물은 신고, 차단 등 강력한 대응을 할 것”이라며 “이번 논란을 통해 (이용자들이) 자정 노력을 했으면 좋겠다”고 당부했다.

오달란 기자 dallan@seoul.co.kr

스캐터랩 김종윤 대표, 블로그에 입장 밝혀

스캐터랩 홈페이지

스캐터랩의 AI 챗봇 ‘이루다’

스캐터랩 홈페이지

스캐터랩 홈페이지

이루다를 개발한 업체는 출시 전부터 예상했던 문제라며 대응책을 마련하고 있다고 밝혔다.

이루다는 AI 전문 스타트업 ‘스캐터랩’이 지난해 12월 23일 출시한 챗봇으로 20살 여성으로 설정돼 있다. 별도 애플리케이션을 깔지 않아도 페이스북 메신저를 통해 의사소통을 할 수 있도록 개발됐다.

이루다는 자연스럽게 대화를 이어갈 수 있고 사용자의 말투를 따라하는 등 실감 나는 채팅으로 인기를 끌면서 이용자가 40만명에 이르렀다.

그런데 출시 후 얼마 지나지 않아 남성 이용자가 많은 디시인사이드, 일간베스트저장소 등 온라인 커뮤니티를 중심으로 이루다에게 성행위를 암시하는 대화, 욕설 등을 학습하게 하는 이른바 ‘성노예 만드는 법’ 등이 공유되기 시작했다.

스캐터랩 홈페이지

AI 챗봇 이루다의 대화 예시

스캐터랩 홈페이지

스캐터랩 홈페이지

김 대표는 “이루다에 대한 성희롱을 예상했다”면서 “인간이 AI에게 욕설과 성희롱을 하는 것은 사용자가 여자든 남자든, AI가 여자든 남자든 크게 차이가 없다”고 설명했다.

김 대표는 문제가 될 수 있는 특정 키워드, 표현 등은 챗봇이 받아주지 않도록 설정했지만 모든 부적절한 대화를 키워드로 막을 수 있는 건 아니라고 밝혔다.

스캐터랩은 처음부터 모든 부적절한 대화를 완벽히 막는 것은 어렵지만 사용자들의 부적절한 대화를 발판 삼아 더 좋은 대화를 하는 방향으로 학습을 시킬 계획이다.

일각에서는 이루다가 마이크로소프트(MS)가 2016년 출시했던 챗봇 테이(Tay)의 전철을 밟을 수 있다고 우려한다. 테이는 사용자들이 인종·성차별 발언을 학습시키는 바람에 혐오발언을 쏟아냈고 MS는 16시간 만에 테이 운영을 중단했다.

김 대표는 이루다가 테이처럼 사라지는 일은 없을 것이라고 장담했다. 그는 “이루다는 사용자와의 대화를 바로 학습에 적용하지 않는다”고 말했다. 나쁜 말을 무작정 따라하지 않도록 학습할 말인지 아닌지 걸러주는 ‘레이블러’가 개입한다는 얘기다.

김 대표는 이루다와 친근한 대화를 나누며 친구처럼 지내는 사용자가 많은 사실을 강조하면서 “일부 과한 게시물은 신고, 차단 등 강력한 대응을 할 것”이라며 “이번 논란을 통해 (이용자들이) 자정 노력을 했으면 좋겠다”고 당부했다.

오달란 기자 dallan@seoul.co.kr

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지